不知道大家是不是和我一样,碰到朋友发消息说借钱,在愿意借的情况下,一般会让对方发个语音或打个电话,甚至直接视频确认对方身份,这样才敢打钱过去。

但现在,这样的操作很有可能会翻车。

事情是这样的,今天早上我刷到了一个视频,一位网友演示他买到的“神奇软件”,能通过提前选定的视频,让对方看到任意的人。

一开始是一位露脸的美女,随后又换成了穿着露脐装的姑娘。

如果这两位是你的好朋友,说的话也是熟悉的声音,你会不会上当受骗?

9秒骗走132万

这并不是耸人听闻,财联社5月25日消息,安徽安庆一位何先生,9秒被AI换脸骗走132万。

当时,何先生接到熟人视频电话,让他帮忙转一笔账,才说了9秒钟,对方便称“在开会”迅速挂断了电话,还称“微信和电话不能说,加一下QQ”。

如果是微信聊天,那大家心里肯定犯嘀咕,但在视频聊天的情况下,何先生也没想太多,便转了钱过去:“因为打了视频电话,又是熟人,我就没多想,就转账了”。

发现被骗之后,何先生迅速报警,专案民警第一时间冻结相关账户,连夜赶赴北京市抓获3名涉诈嫌疑人,追回何先生被骗的132万元。

无独有偶,在这件事发生前不久,央视也报道了一起金额高达430万元的AI换脸诈骗,过程几乎差不多。

福建福州的郭先生收到好友打来的微信视频,两人寒暄几句后,好友说自己的朋友在外地投标,需要430万元保证金,且需要公对公账户过账,所以想要借用郭先生公司的账户走一下账。

郭先生见视频中的面孔和声音确实是“好友”,于是放松了警惕,仅在10分钟之内就向对方转账430万元。

但郭先生没那么幸运,在福建、包头两地警方、银行的帮助下,其中300多万元被拦截,目前仍有90多万还在追查中。

AI诈骗手法

很明显,郭先生与何先生,都陷入了一场利用AI技术实施的诈骗。

骗子是先盗取了他们好友的微信,并收集了好友大量的图片、音视频信息,用以训练模型,最后通过AI实时渲染出的人物,来和他们微信视频,骗走钱财。

值得注意的是,骗子不是漫无目的地广撒网,而是别有用心地锁定诈骗对象。

他们会分析诈骗对象在网络平台发布的个人信息,根据所要实施的骗术利用AI技术对人群进行筛选,从而选出目标对象,制定诈骗计策。显然,郭先生就是被精心挑选出来的诈骗对象。

最恐怖的是,这种操作的门槛并不高。

CCTV记者找到一位提供人脸识别软件的卖家,人脸动作制作软件和教程售价仅为1299元。记者尝试后发现,AI制作出来的人脸,能通过90%的人脸检测App。

如果你遇上了,能够分辨出来吗?

除了AI换脸,AI技术还被用于以下几种诈骗方式。

第一种是声音合成,骗子通过骚扰电话录音等来提取某人声音,获取素材后进行声音合成,从而可以用伪造的声音骗过对方。

第二种是转发微信语音,在盗取微信号后,骗子便向其好友“借钱”,为取得对方的信任,他们会转发之前的语音,进而骗取钱款。尽管微信没有语音转发功能,但他们通过提取语音文件或安装非官方版本(插件),可实现语音转发。

此外,现在大家接到的骚扰电话、广告电话、诈骗电话,大多数都不是真人,而是AI了。

去年警察打掉的一个“推荐股票”的犯罪团伙,就是用AI设定好声音,然后无差别给人打电话。一天就能打数千个电话,这在以前得上百人的团队才能做到。

绝大多数人一听肯定就挂掉了,但只要基数够大,他们总能找到一些没有防备的“优质客户”,随后通过人工介入一步步诱骗,几年时间搞了1.8个亿。

每次新技术出来,永远是违法犯罪钻空子的先用上。

在AI技术越来越强大的今天,AI诈骗已经连年轻人都防不胜防,更别提老人了。赶紧提醒下家里的长辈,千万不要踩到这个雷。

AI造假已无处不在

AI技术是一把双刃剑,用好了,它能颠覆人类的生活。

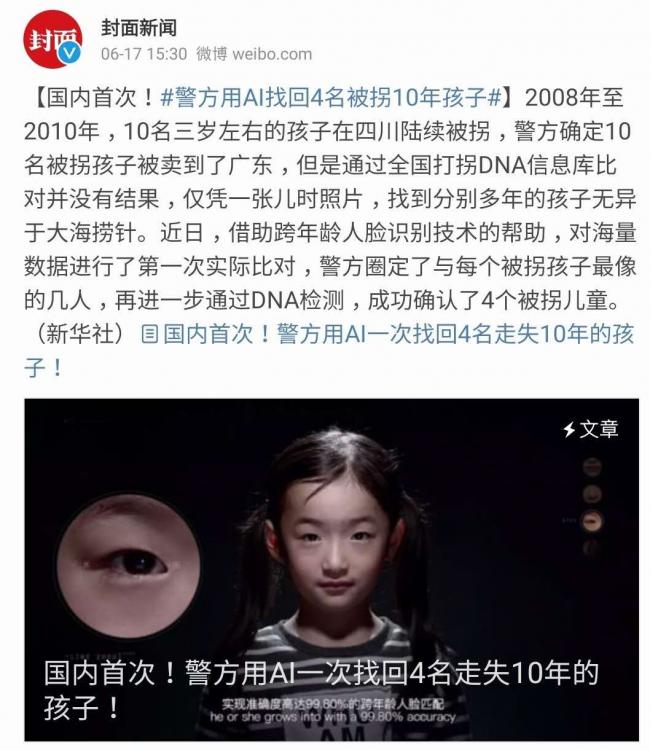

早在几年前,便有警方通过AI技术,找回了4名被拐长达10年的儿童,使用的仅仅是TA们一张儿时的照片。

也有公司使用AI技术,实现“一件穿衣”功能,让大家在网上购物时,也能拥有到试衣的体验。

而随着ChatGPT的诞生,AI在已经能在方方面面,提高人类的工作和生产效率,或许在未来,人类每月只用工作一个礼拜。

但同时,它也成为了骗子手中的利器,如今AI造假已无处不在。

AI一键脱衣,几个月前一位广州的小姐姐就中招了。她只是在小红书上,发了张自己坐地铁出门的普通照片,没想到却被人用AI“一键脱衣”,并配上虚构的文字造黄谣。

在时间、地点都对得上的情况下,搭配AI强大的算法,这个伪造出的谣言让不少人信以为真,还在那猜测事情的原因,对当事人造成了极大伤害。

还有用AI换上明星的脸,然后带货的。近日,有网友点开直播间,发现正在卖货的竟是当红女星,包括杨幂、迪丽热巴、angelababy等等。

然而定睛一看,这些带货“明星”很快露出了马脚——身穿中式服装,只是使用了AI实时换脸技术的普通主播。

前些天,外网还有位性感的日本女议员火了,被网友扒了下发现,也是AI制作出来的,欺骗了一大群宅男的感情。

科技是用来造福人类的,让世界变得更美好才是科技发展的最终目的,如今的AI技术更应当如此。

加强对它的研究和监管,保护人们的隐私和尊严的权益,才能让数字化的生活变得更加美好、安全。